1. 文章

1.1 重构开发范式:AI 时代下全栈开发的实践与思考

- 从“搬砖”到“架构”: 编写具体的 CRUD 代码已不再是核心竞争力。定义 Skill、设计系统边界、构建让 AI 高效工作的“上下文环境”成为新的关键能力。

1.2 我研读了 Hermes Agent 的记忆系统,它弥补了 OpenClaw 的设计缺陷 - Lumina

- Hermes 在 ~/.hermes/memories/ 下的两个文件中存储持久性记忆: 文件目的限制MEMORY.md智能体关于环境、约定、工具怪癖、经验教训的笔记2,200 字符USER.md用户配置文件:偏好、沟通风格、身份1,375 字符

- 如果 MEMORY.md 和 USER.md 是 Hermes 的热记忆,那么 session_search 就是其长尾回忆系统。

- 当模型需要从之前的对话中回忆某些内容时,Hermes 不会 搜索 MEMORY.md。它会搜索会话数据库。

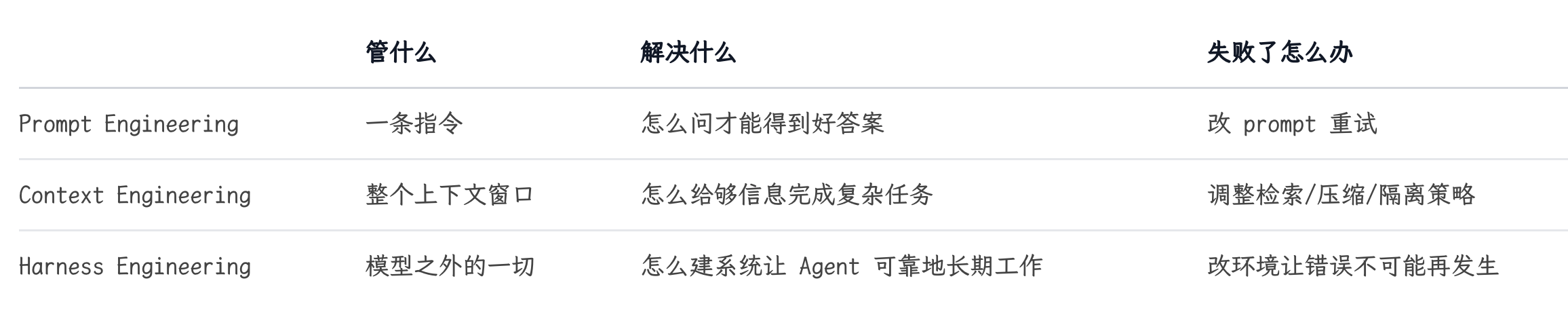

1.3 Harness Engineering — Agent 不好用,也许不是模型的问题 - Lumina

- Harness 就是除了模型权重以外的一切。

- Prompt Engineering 大家已经很熟了——few-shot、CoT、角色扮演。

- Context Engineering 是 2025 年 Karpathy 推动的概念升级。核心思想是:不要只关注 prompt 本身,要关注 整个上下文窗口的管理 。LangChain 总结了四个策略:Write(写到外部存储)、Select(按需检索)、Compress(压缩)、Isolate(隔离子任务的上下文)。

- Harness Engineering 再往外扩一层:不只管上下文窗口内的事,还管 执行环境、工具、持久化、反馈循环、架构约束 这些上下文窗口之外的东西。

1.4 理解 KV Cache 与 Prompt Caching:LLM 推理加速的核心机制 | chaofa用代码打点酱油

这里的 Q / K / V 分别就是:

Q = Query(查询向量) K = Key(键向量) V = Value(值向量)

它们是 Attention 机制里,每个 token 在每一层都会生成的三种表示。

假设你在会议室里问问题:

Q = 你心里要找的问题关键词 K = 每个人胸前挂的“我懂什么”的标签 V = 那个人真正能说出来的内容

流程就是:

你拿着自己的 Q 去和所有人的 K 做匹配 匹配分高的人更值得关注 然后把这些人的 V 按权重加权汇总 得到你这一刻的新理解

这就是 Attention。

为什么要分成三个,不直接一个向量不行吗?

因为这三个角色不同:

Q 负责“主动发起匹配” K 负责“被匹配” V 负责“被取用的信息内容”

如果只用一个向量:

匹配空间和内容空间耦合在一起 表达能力更弱 模型更难学到“用什么标准检索”和“检索到后返回什么内容”这两个不同任务

总结:

在朴素实现里,每一步都会对整个序列所有 token 重新计算各层的 Q/K/V,并重新做 attention。 但在增量解码时,历史 token 的 K/V 可以缓存复用,因为它们对未来 token 来说是固定“记忆库”; 每一步只需要为新 token重新计算当前层的 Q/K/V,然后用它的 Q 去和缓存的历史 K 做匹配,再对缓存的历史 V 做加权汇总。

其他

- 如果两次 API 调用的 prompt 有相同的前缀,那么第二次调用可以直接复用第一次 Prefill 阶段算出来的 KV Cache,跳过前缀部分的 Prefill 计算。

- 多轮对话:每轮对话的 prompt 都以之前的对话历史作为前缀

- 相同 system prompt:同一个应用的所有请求共享相同的 system prompt 前缀

- Agent 系统:Agent 每一步的 prompt 都是上一步的 prompt 加上新的 action/observation

- 必须从第一个 token 开始完全一致,一个 token 的差异就会导致该位置之后的 cache 全部失效。

- 这个"前缀精确匹配"的约束,在 AI Agent 系统中变得尤为关键。Agent 每一步都要发送越来越长的 context(历史对话 + 工具调用结果),如果不精心设计 prompt 结构,cache 命中率会很低,成本和延迟都会飙升。

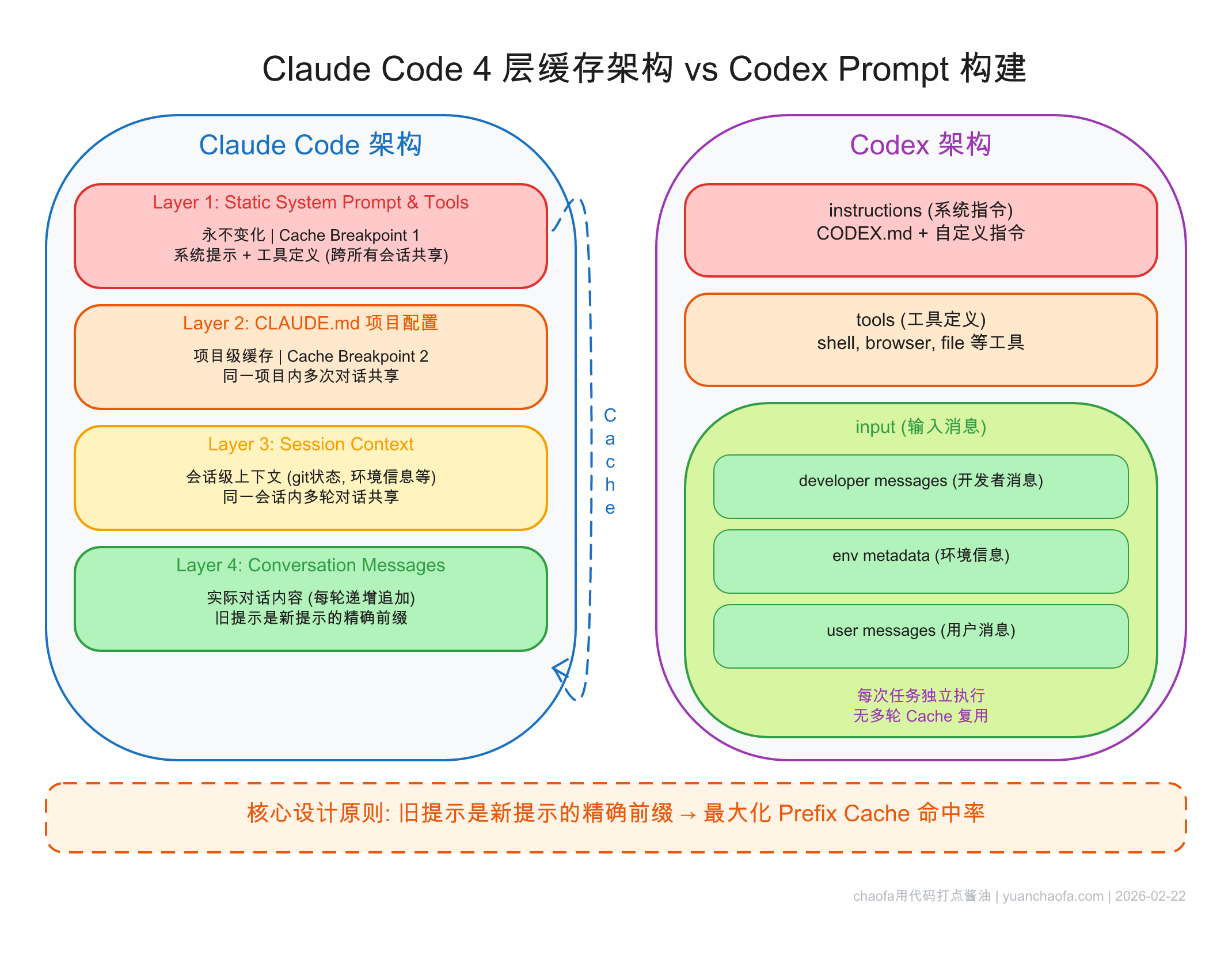

1.5 Agent 系统中的 Prompt Caching 设计(上):Cache 破坏、Prompt 布局与工具管理 | chaofa用代码打点酱油

-

Prompt Cache 不只是一个省钱技巧,它是 Agent 系统架构设计的核心约束。

-

prompt 怎么组织?→ 稳定内容放前面,变化内容放后面

-

工具怎么管理?→ 工具列表固定,通过其他机制限制可用范围

-

状态怎么切换?→ 不切换工具,用工具模拟状态转换(Claude Code Plan Mode 就是最好的例子)

-

context 怎么压缩?→ 压缩操作本身必须 cache-safe

-

模型怎么选?→ 不在同一会话中切换,用子代理隔离

-

前缀不变:system prompt、tools、早期历史永远不修改

-

追加不修改:Append-only,永远不编辑历史消息

-

工具定义稳定:tools 数组不变,通过其他机制控制可用范围

-

动态信息后置:时间戳、环境状态等放在后面的 user message 中

-

压缩必须 cache-safe:压缩操作复用父对话的 cache prefix

-

Cache 是 model-specific 的。一个反直觉推论:100K token 对话中,切换到更便宜的模型可能更贵 —— Opus 的 100K cached token 只需 $1.50,换 Haiku 后全部重算。

-

Cache Breakpoint 与 Auto-caching

Claude API:从手动 cache_control breakpoint → auto-caching 一个参数搞定

OpenAI API:prompt_cache_key 路由优化,自动缓存 ≥1024 token 前缀

反直觉:900 token prompt 永远不 cache hit,扩展到 1024+ token 反而更省钱。

1.6 Agent 系统中的 Prompt Caching 设计(下):上下文管理与子代理架构 | chaofa用代码打点酱油

-

更大的 context window 不是万能解药。 能塞进去不代表模型能有效利用。

-

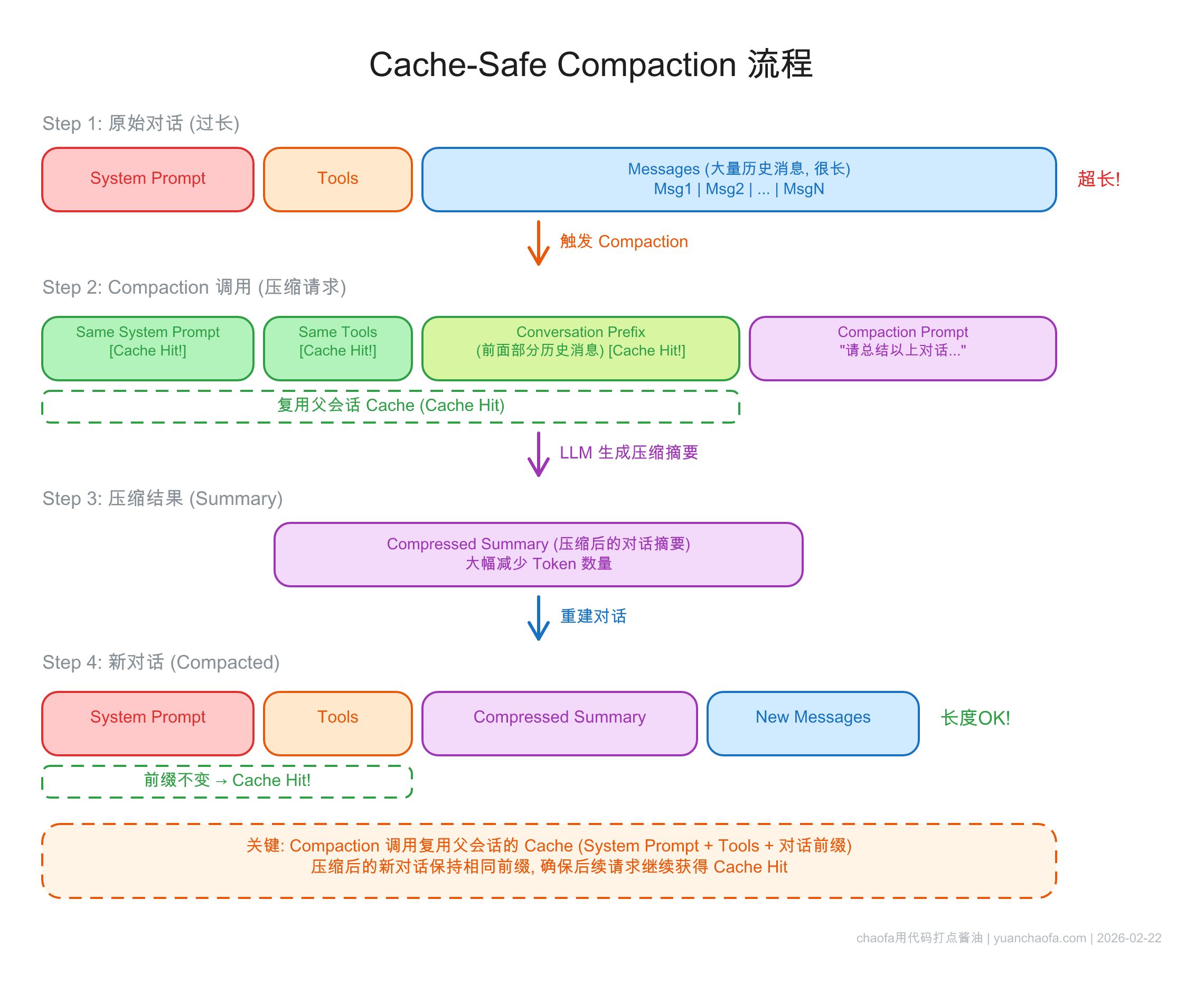

压缩是解决 context 增长的关键手段,但必须是 cache-safe 的。

-

Claude Code 的压缩策略非常精巧:

压缩请求使用完全相同的 system prompt + tools + 对话前缀

只在末尾追加 compaction prompt

这样压缩请求本身就能复用父会话的 cache

预留 “compaction buffer”——context 快满之前就开始压缩

-

文件系统当"无限 context":执行结果写入文件,context 只保留引用

-

用 glob/grep 搜索文件系统,无需向量索引。

-

Fork 出的子任务必须用和父对话相同的 prompt prefix,才能复用父对话 cache。

-

Claude Code 在 compaction、summarization、skill execution 中都遵循这个原则。核心思想:压缩/fork 是在现有 cache 基础上的延伸,而非另起炉灶。

1.7 4G Spaces — 2016 年,我做过一次 AI 写代码创业

-

未来并不是线性展开的。

所以,焦虑并不能真正帮助我们接近未来。更重要的是,在你当下所能看到的边界之内,做一个对得起自己的选择;至于剩下的部分,就交给时间。

1.8 OpenClaw 与 Agent 的未来 | Bojie Li

-

反共识观点:通用 Agent 的核心不是 Computer Use——而是 Coding Agent。所有高效内容生成最终都通过代码实现:PPT = ZIP + XML 代码,Word = JS 代码生成,比 GUI 操作快几个数量级。

-

丰富的 Connector:21 个聊天渠道——Telegram、iMessage、WhatsApp。不用坐在电脑前,手机发条消息就能指挥 Agent。

-

No Session 设计:像跟真人聊天一样,不用想”在哪个对话里问”。Agent 记得所有历史交互——ChatGPT 和 Cursor 做不到。

-

Skills + CLI 生态:社区贡献即插即用的能力扩展。Skills 本质上是动态注入的 System Prompt——让 Agent 知道有什么工具、怎么用。

-

Agent = 模型 + 上下文 + 工具/动作空间

-

根本局限:Personal Assistant 范式——one person, multiple agents。不支持多用户协作,天然不是企业级产品。99% 的人最终会用企业级 Agent,就像 99% 的人用银行存钱而非加密钱包。

-

结构化文件存储

MEMORY.md — 核心事实和用户偏好(长期记忆)

memory/2026-03-21.md — 按日期归档的每日交互日志

AGENTS.md — Agent 对自身能力的反思

-

未来有价值的三种人

- 电影导演型(0→1 创造):定义产品愿景。瓶颈是创造性判断力。

- 城市规划师型(1→100 架构):管理系统规模化。瓶颈是架构判断力。

- F1 赛车手型(极限研究):推进 AI 前沿。瓶颈是科学洞察力。

- 共同点:核心能力都不是”写代码”,而是判断力。

-

关于 Context 的重要性

- 团队合作最大的问题是 context 不一致。

- AI 短期内无法取代人,最大原因也是 context——它在公司里能访问到的 context 远低于一个人类员工。

- 如果模型有无限 context,最大的应用场景就是做 CEO——解决组织中 context sharing 不一致的千古难题。

-

AI 能取代的 vs 不能取代的

- 第一个被 AI 替代的是 researcher,然后是 infra engineer,最难替代的是 sales。

- AI 能取代的,是没有自己想法、只执行上级指令的人。 拥有隐性知识、历史原因、未曾表达的想法的人,才是不可替代的。人类的核心竞争力不是写代码,而是判断力和对 context 的掌握。

-

对真人来说很难的写代码,AI 干得很快;但对真人来说很简单的操作 GUI,AI 搞不定。

-

电子表更准更便宜,但百达翡丽的价值恰恰在于人类工匠花数百小时亲手打磨。当 AI 能完成一切信息工作,”由人类完成”本身就成为价值的来源。

2. 项目

2.1 zhaoolee/notes: 一个高仿锤子便签的小工具,支持skill调用,支持导出便签为图片

zhaoolee/notes

一个高仿锤子便签的小工具,支持skill调用,支持导出便签为图片

支持将markdown文档导出为锤子便签的样式。不过需要自己再部署一个后端服务。这个后端服务是用TS写的。

2.2 tmwgsicp/wechat-download-api: 一款完全开源的微信公众号文章获取、 RSS 订阅API服务,支持IP代理池反风控。

tmwgsicp/wechat-download-api

一款完全开源的微信公众号文章获取、 RSS 订阅API服务,支持IP代理池反风控。

2.3 iOfficeAI/AionUi at 8c9b8256af045be757617c7117eadb72f465e06c

一个开源的cowork框架。

2.4 chenhg5/cc-connect: Bridge local AI coding agents (Claude Code, Cursor, Gemini CLI, Codex) to messaging platforms (Feishu/Lark, DingTalk, Slack, Telegram, Discord, LINE, WeChat Work). Chat with your AI dev assistant from anywhere — no public IP required for most platforms.

chenhg5/cc-connect

Bridge local AI coding agents (Claude Code, Cursor, Gemini CLI, Codex) to messaging platforms (Feishu/Lark, DingTalk, Slack, Telegram, Discord, LINE, WeChat Work). Chat with your AI dev assistant from anywhere — no public IP required for most platforms.

2.5 qiaoshouqing/drive-escape: 周末自驾逃离计划 - 交互式驾车时间地图

qiaoshouqing/drive-escape

周末自驾逃离计划 - 交互式驾车时间地图

2.6 runkids/skillshare: 📚 Sync skills across all AI CLI tools with one command and simplify team sharing. Supporting Codex, Claude Code, OpenClaw & more

runkids/skillshare

📚 Sync skills across all AI CLI tools with one command and simplify team sharing. Supporting Codex, Claude Code, OpenClaw & more

2.7 TomBadash/Mouser: A lightweight, open-source, fully local alternative to Logitech Options+ for remapping Logitech HID++ mice.

TomBadash/Mouser

A lightweight, open-source, fully local alternative to Logitech Options+ for remapping Logitech HID++ mice.

2.8 [FireRedTeam/FireRed-OpenStoryline: FireRed-OpenStoryline is an AI video editing agent that transforms manual editing into intention-driven directing through natural language interaction, LLM-powered planning, and precise tool orchestration. It facilitates transparent, human-in-the-loop creation with reusable Style Skills for consistent, professional storytelling.]

(https://github.com/FireRedTeam/FireRed-OpenStoryline )

FireRedTeam/FireRed-OpenStoryline

FireRed-OpenStoryline is an AI video editing agent that transforms manual editing into intention-driven directing through natural language interaction, LLM-powered planning, and precise tool orchestration. It facilitates transparent, human-in-the-loop creation with reusable Style Skills for consistent, professional storytelling.

2.9 alibaba/page-agent: JavaScript in-page GUI agent. Control web interfaces with natural language.

alibaba/page-agent

JavaScript in-page GUI agent. Control web interfaces with natural language.

阿里开源了一个前端库。比如这个库就可以通过大模型操作网页的元素。比如完成表单的填写以及一些页面的点击之类的。

2.10 noah-nuebling/mac-mouse-fix: Mac Mouse Fix - Make Your $10 Mouse Better Than an Apple Trackpad!

noah-nuebling/mac-mouse-fix

Mac Mouse Fix - Make Your $10 Mouse Better Than an Apple Trackpad!

2.11 AnInsomniacy/motrix-next: A full-featured download manager — rebuilt from the ground up

AnInsomniacy/motrix-next

A full-featured download manager — rebuilt from the ground up

2.12 kepano/defuddle: Get the main content of any page as Markdown.

kepano/defuddle

Get the main content of any page as Markdown.

2.13 f/prompts.chat: f.k.a. Awesome ChatGPT Prompts. Share, discover, and collect prompts from the community. Free and open source — self-host for your organization with complete privacy.

f/prompts.chat

f.k.a. Awesome ChatGPT Prompts. Share, discover, and collect prompts from the community. Free and open source — self-host for your organization with complete privacy.

评论